COMETIC

通过基于光标的互动隐式校准增强智能手机眼动追踪

2024

Chang Liu, Xiangyang Wang, Chun Yu, Yingtian Shi, Chongyang Wang, Ziqi Liu, Chen Liang, Yuanchun Shi

智能手机上的眼动追踪准确性有限,限制了其应用。现有的基于RGB摄像头的眼动追踪系统依赖于大量的数据集,而这些数据集可以通过利用用户交互中隐式收集的校准数据进行持续微调来改进。在此背景下,我们提出了COMETIC(Cursor Operation Mediated Eye-Tracking Implicit Calibration,基于光标操作的眼动追踪隐式校准),它引入了一种基于光标的交互方式,并利用光标与眼动之间的内在关联。

智能手机上的眼动追踪

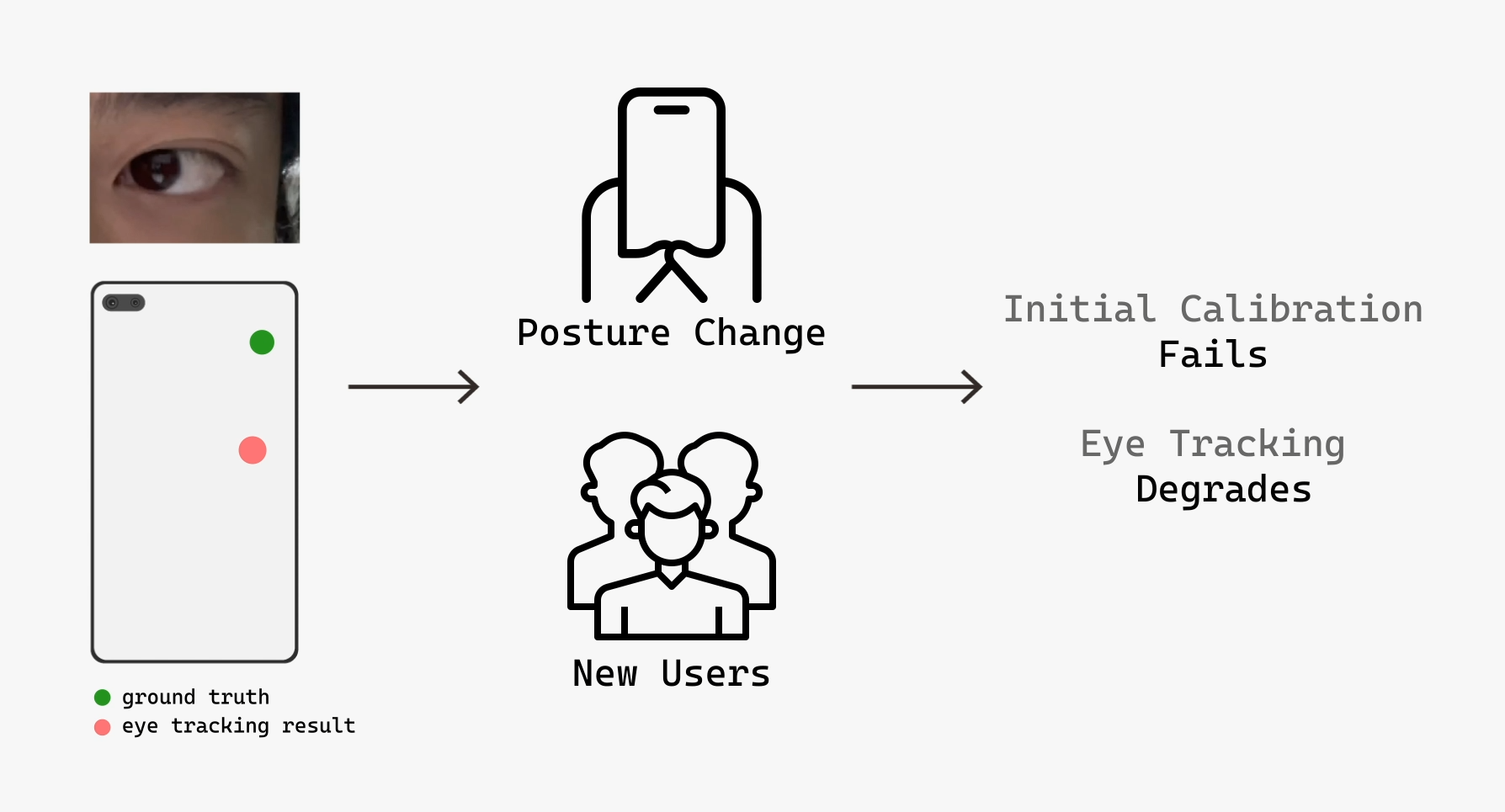

当前智能手机眼动追踪面临两个主要挑战:对个体用户的个性化支持有限,以及难以适应频繁的姿势变化。为了解决这些问题,我们开发了一种通过隐式用户交互动态校准眼动追踪的系统,从而提高了准确性和个性化。

COMETIC

通过将有效的光标坐标作为注视真实值的代理,并结合相应的图像对眼动追踪模型进行微调,COMETIC在交互过程中提高了准确性。过滤和微调过程都利用了预训练模型,并且可以通过个性化的、动态更新的数据进一步提升性能。

COMETIC的工作流

COMETIC的交互和模型架构

数据收集实验

数据收集实验的设备和界面

评估

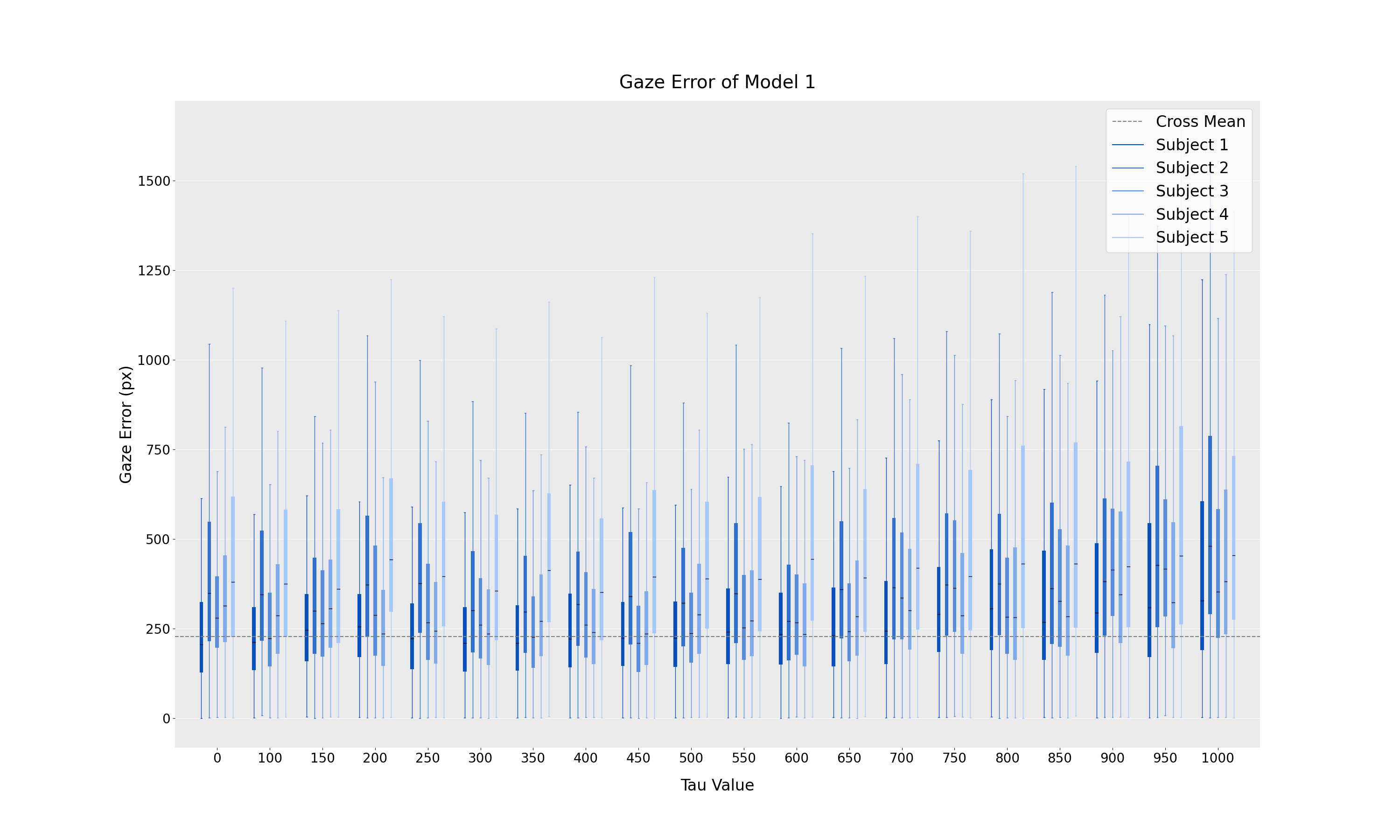

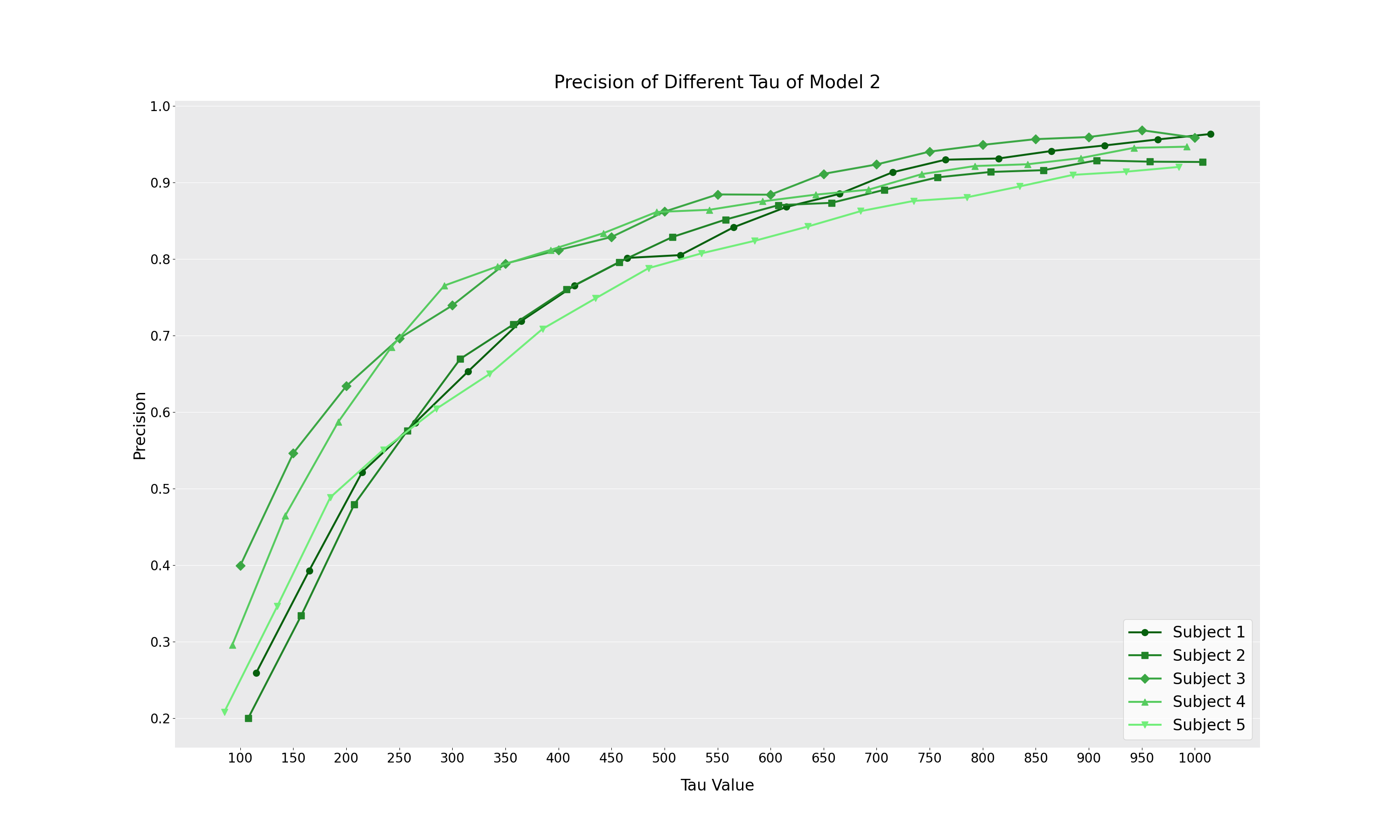

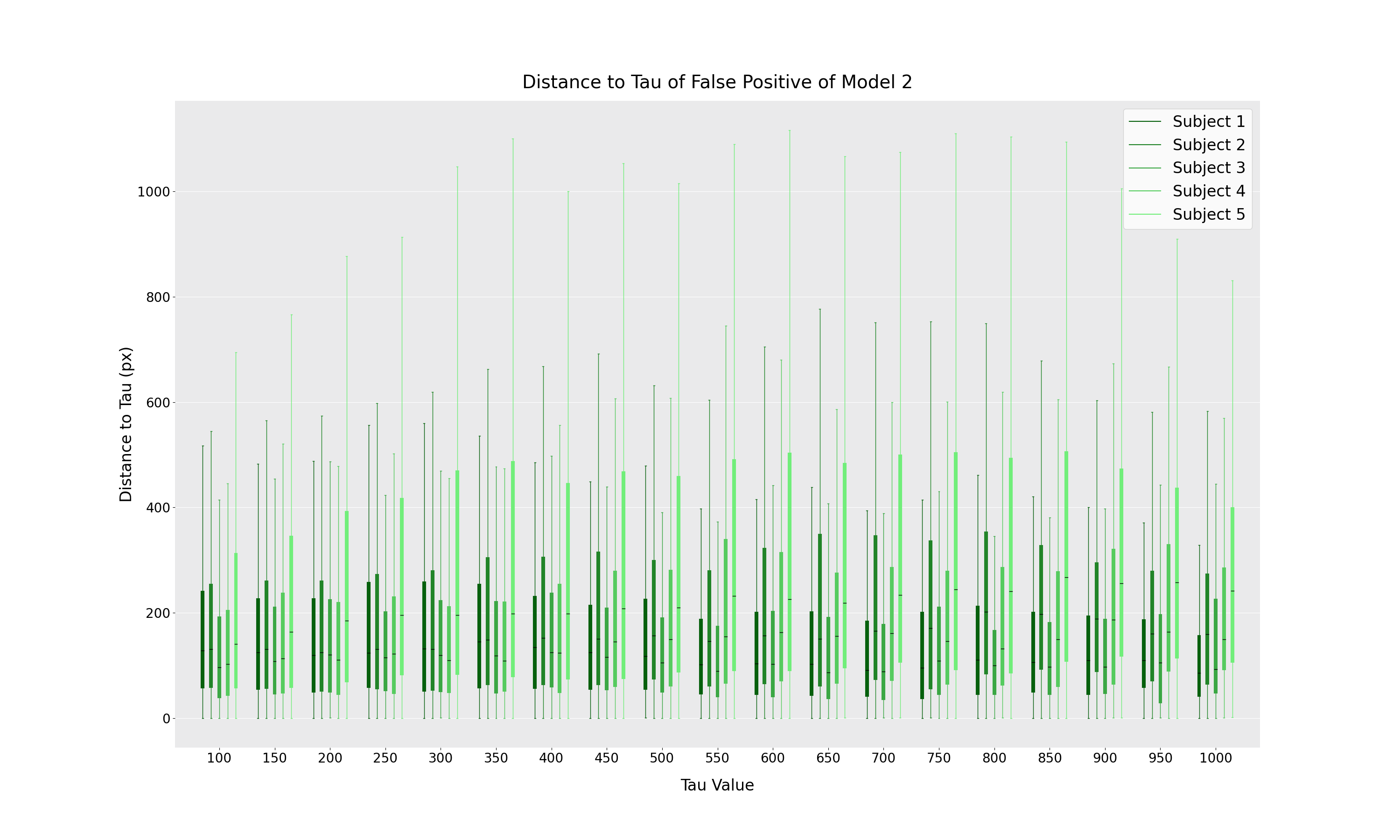

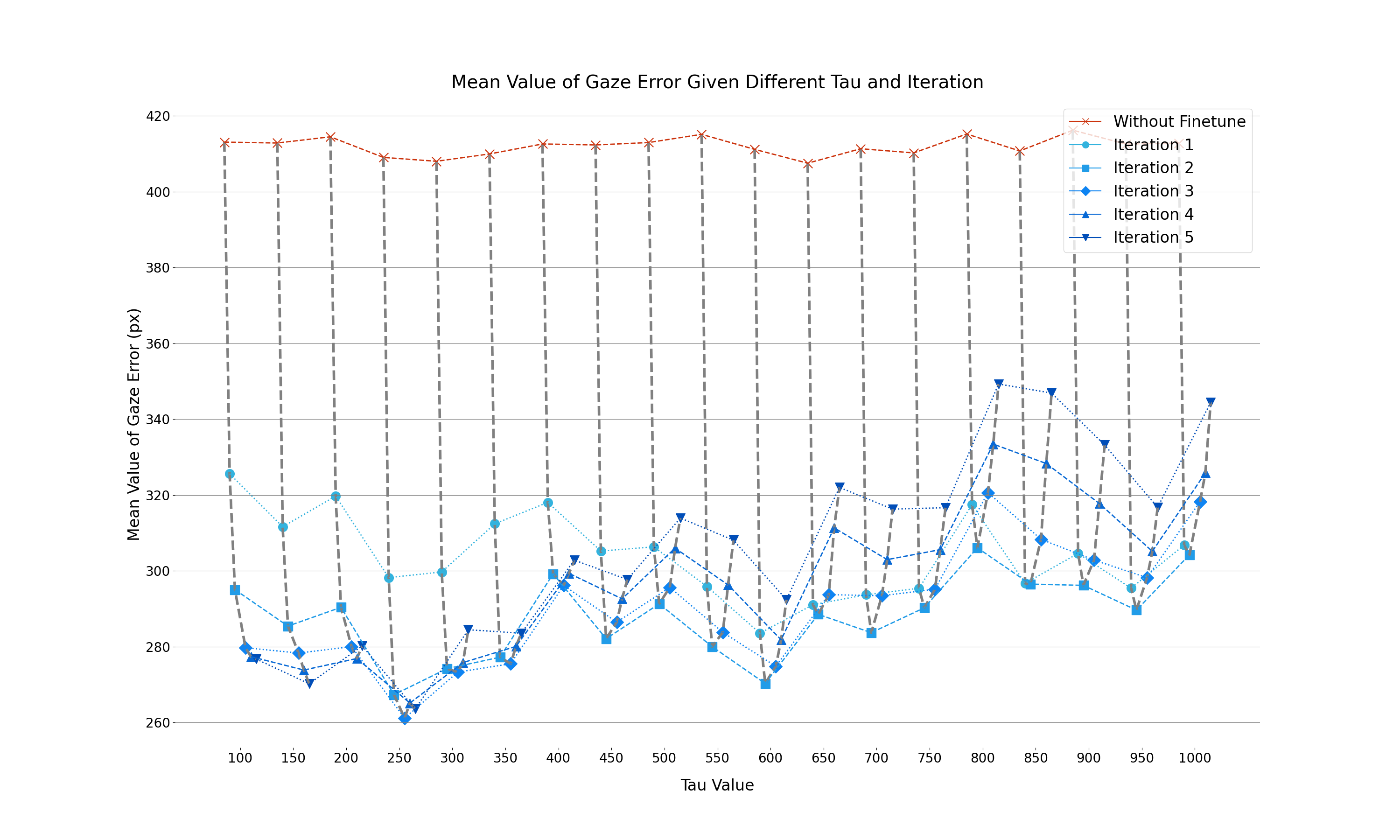

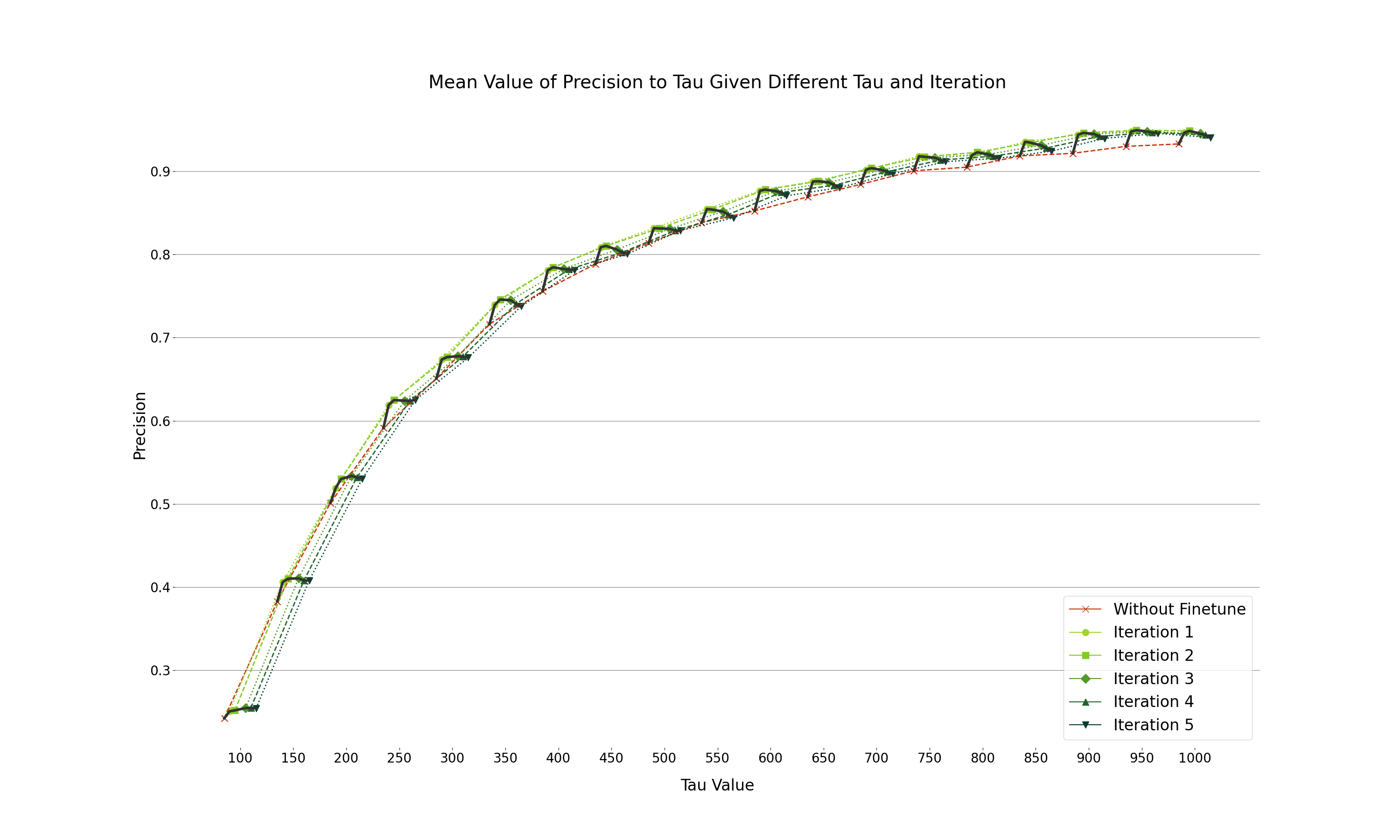

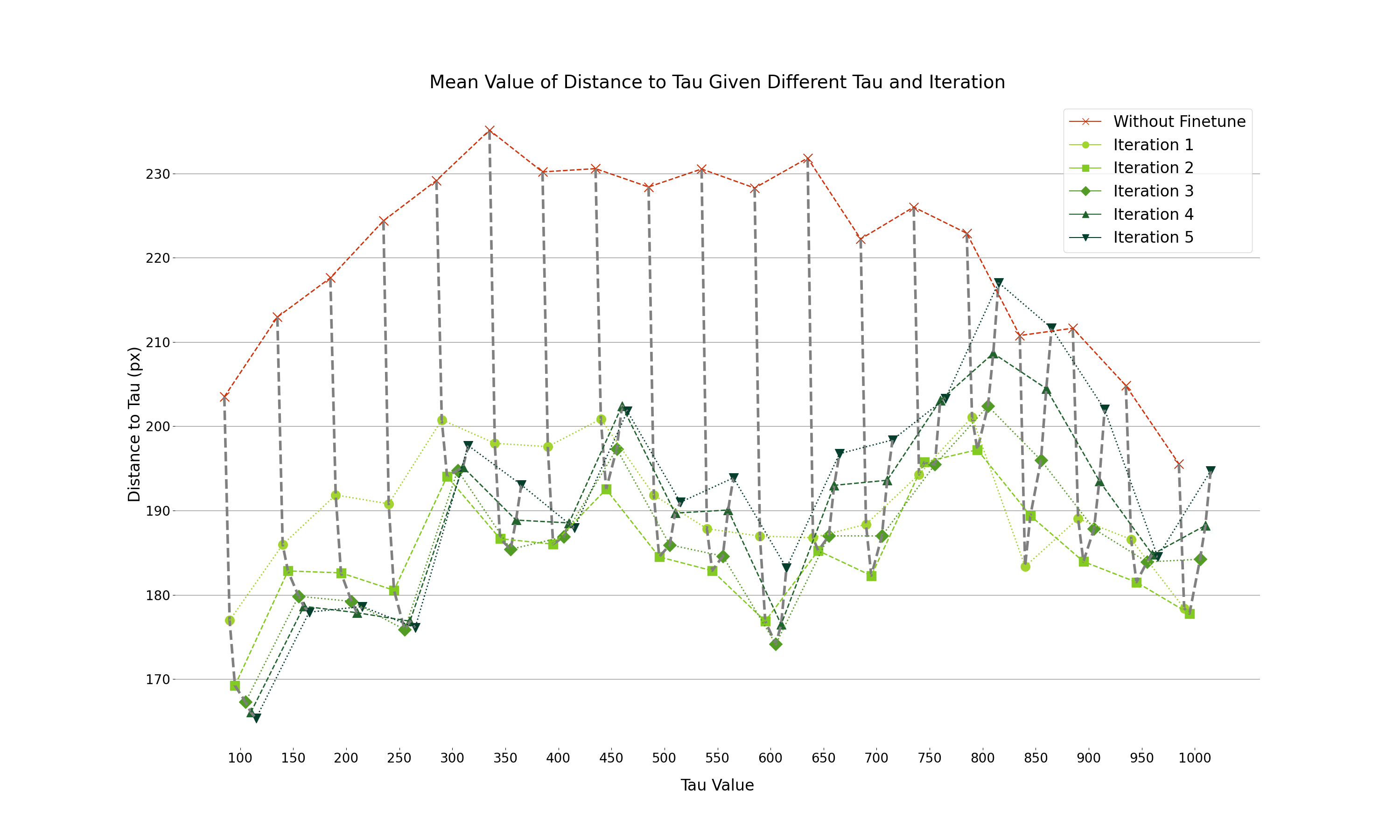

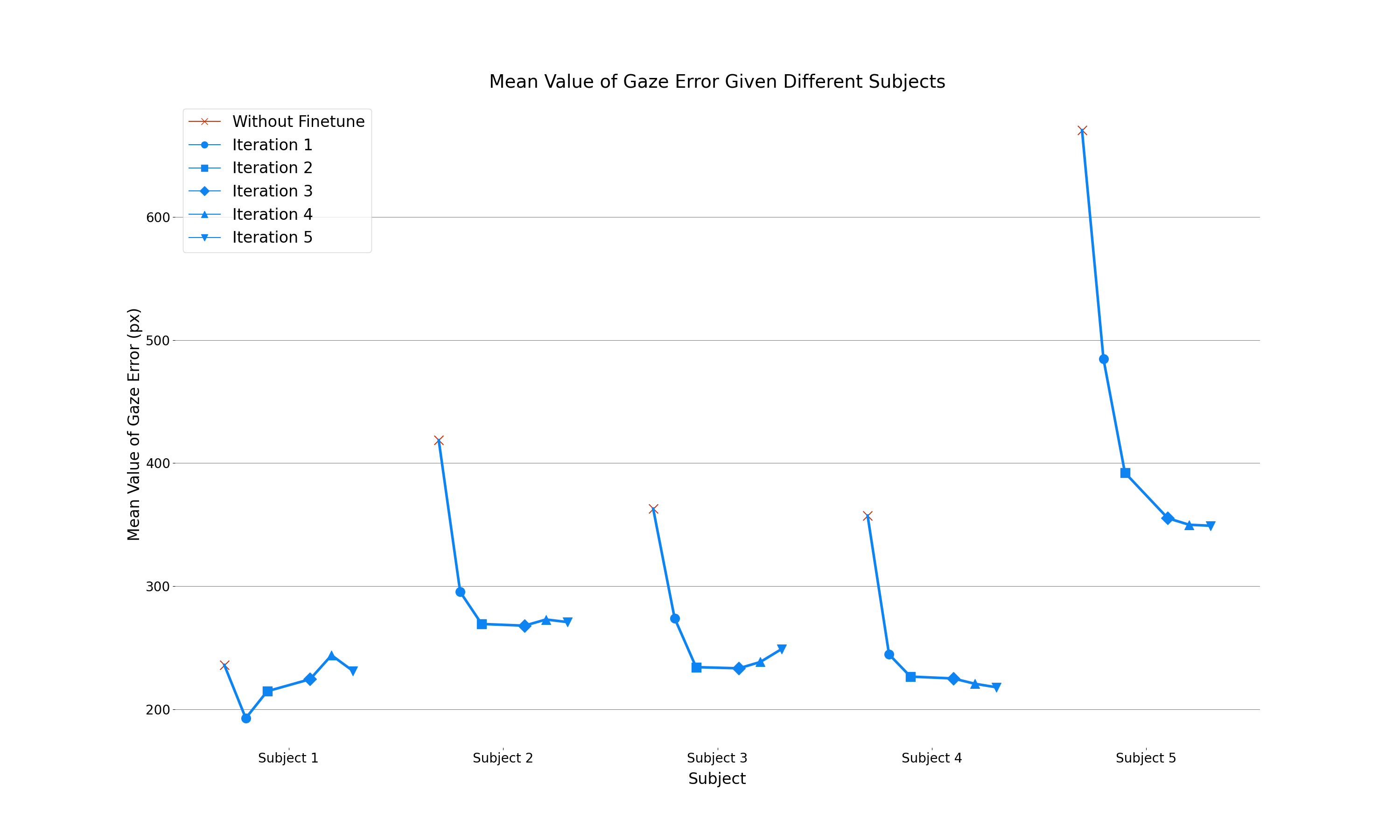

结果表明,COMETIC实现了平均眼动追踪误差为208.04像素(1.2厘米),相比于未进行微调的系统提高了49.64%。分析还显示,过滤光标点时,当实际注视距离在250到300像素(1.44到1.73厘米)之间时,能够获得最佳的眼动追踪效果。